El 3 de enero último la primera imagen del secuestrado presidente Nicolás Maduro Moros era toda pompa al mejor estilo hollywoodense. El mandatario bolivariano, vestido de traje, aparecía custodiado por efectivos del ejército de Estados Unidos. Al fondo, un helicóptero. La foto tenía, además, la fecha en cuestión, en idioma inglés. Pero era falsa. Se trató de una superposición a partir de la captura, hace unos años, de un capo narcotraficante mexicano.

Similar a esa foto se difundió otra que mostraba a Maduro Moros en el momento de su traslado ilegal a Nueva York, a bordo de un avión de las fuerzas armadas estadounidenses. También era falsa, generada con inteligencia artificial. Sin embargo, ambas imágenes fueron compartidas miles de veces en redes sociales como Facebook, TikTok e Instagram. El bulo caminó como pan caliente.

No sorprende. La difusión de noticias falsas no es algo nuevo. De hecho, si miramos atrás, la voladura del acorazado Maine en La Habana, hecho amplificado luego hasta la saciedad por la prensa estadounidense, fue un autoatentado de tal magnitud que sirvió de pretexto al Gobierno de Estados Unidos para inmiscuirse en nuestra lucha independentista. Y ya sabemos cómo terminó todo. El hecho fue eral, pero la noticia fue totalmente falseada.

En los momentos actuales, cuando usted lee sobre guerra multidimensional, de esto se trata. Además de las operaciones militares tradicionales, los poderosos de este mundo despliegan una feroz maquinaria que difunde mensajes cuidadosamente preparados (o no), para generar zozobra entre la población. La mayoría de las veces, el contenido de estos mensajes toca fibras sensibles, y se preparan desde la emoción.

Estudios demuestran que, en internet, los usuarios reaccionan más por emoción que por raciocinio. Y solo el 30 por ciento de los que se exponen a algo falso, se enteran luego de que lo que vieron o leyeron era mentira. Por eso, quizá, sea necesario estar atentos a los bulos, y desconfiar absolutamente de todo, a no ser que le llegue de una fuente confiable, y entiéndase esto último, en el caso nuestro, por un canal oficial.

Misiles digitales

Mientras Washington bombardeaba Caracas y otras localidades de Venezuela, en redes como X (antes Twitter), se desencadenó una operación de desinformación a gran escala. Un ejemplo fue un video de supuestos misiles cayendo sobre Fuerte Tiuna, en la capital venezolana, metraje que en realidad mostraba misiles iraníes disparados sobre Israel el año pasado, cuando escalaron las tensiones entre ambos países a raíz de la agresividad sionista, con la venia de su aliado, Estados Unidos.

Asimismo, las redes y aplicaciones de mensajería como WhatsApp y Telegram replicaron audios con mensajes de voz generados por inteligencia artificial, atribuidos al presidente Maduro, supuestamente filtrados a través de su abogado defensor desde la cárcel donde lo tienen detenido en Nueva York.

Por otro lado, circuló una foto del supuesto captor de Maduro, un oficial de la fuerza de élite Delta Force, que sería de origen cubano, nacido en el municipio de Cotorro. Por múltiples razones, la imagen es totalmente falsa. Según respondió Grok, el chatbot de IA de X, al Observatorio de Medios de Cubadebate, en esa imagen saltaba a la vista una «iluminación perfecta, texturas impecables en el equipo, proporciones faciales ideales y un fondo difuminado artificial. Búsquedas de imágenes similares revelan que esta foto circula exclusivamente en posts sobre el rumor de Mendieta, y comparada con ejemplos conocidos de soldados Delta Force generados por IA (como modelos 3D o stock photos), comparte características comunes: casco con NVG cuádruple, chaleco con parche «DELTA FORCE» estilizado (raro en fotos reales), bandera estadounidense invertida en algunos casos y pose dramática».

A la vez, otras cuentas difundían una foto de un supuesto eufórico pueblo venezolano retirando carteles con la imagen de Maduro en Caracas, hecho que en realidad había acontecido de manera natural en noviembre de 2025, y otro video se hizo viral en X mientras mostraba a Maduro «torturando» a «disidentes venezolanos». El único problema con ese video es que es la escena de una película.

Cuba en la mira

En los últimos meses las campañas de desinformación contra Cuba han aumentado de manera significativa, y este no es un hecho menor. Solo el pasado domingo, fueron desmentidos un supuesto aumento del precio del pasaporte para residentes en el exterior, una paralización de actividades en el país y la detención del curso escolar.

En diciembre, Aguas de La Habana había desmentido una supuesta contaminación de la fuente de abasto conocida como El Gato, y unos días antes el Ministerio de Turismo tuvo que aclarar que era falsa una noticia que circuló en redes y plataformas digitales que alegaba se entregarían donaciones en hoteles cubanos tras el paso del huracán Melissa.

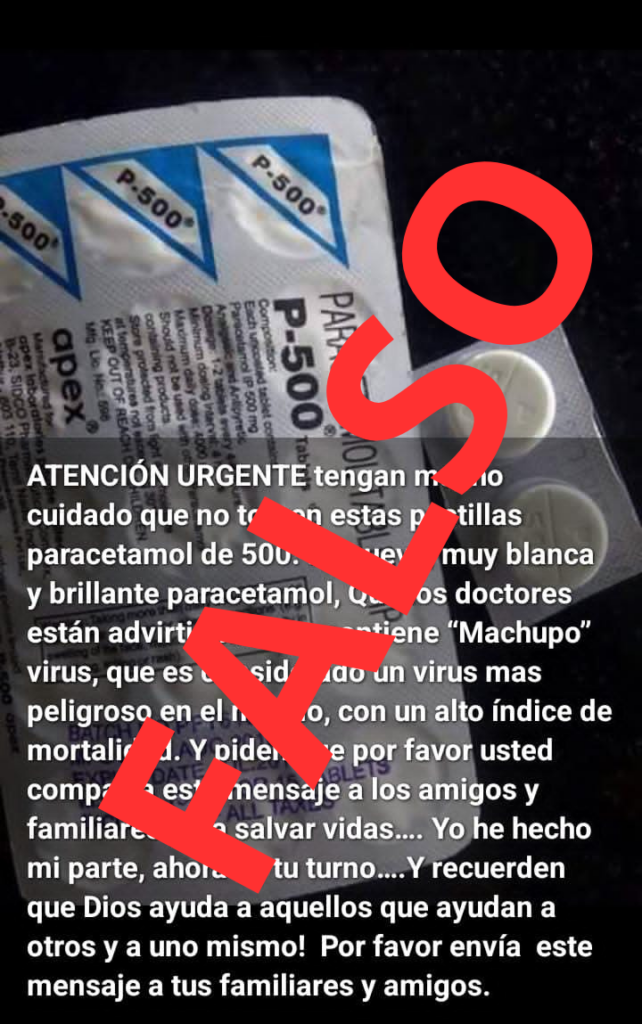

También ha circulado, sobre todo en WhatsApp, una imagen con un paracetamol que estaría contaminado con el Machupo, un virus letal. Sin embargo, un simple rastreo de la información revela que esta noticia falsa camina por las redes desde hace años, y se puede encontrar un desmentido al respecto del ministerio de Salud panameño en el año 2017. Este bulo del paracetamol con Machupo también se extendió por Ecuador y Argentina en años recientes.

Incluso, continúan las viejas estafas de «regalos» en fechas significativas, en las que Etecsa o Transfermóvil brindarían algo si se entra en un enlace que es compartido, sobre todo, entre contactos de WhatsApp, y no son pocos los incautos que caen en esta farsa. Aquí las consecuencias pueden variar, pero generalmente llevan a que se instalen en los teléfonos todo tipo de virus, además de posibles robos de credenciales en cuentas o información sensible, como la bancaria.

Qué puedes hacer

Si bien la inteligencia artificial avanza a un ritmo en el que cada vez más borra las fronteras entre la verdad y la mentira, y al mismo tiempo los enemigos de Cuba se afanan en desarrollar todo tipo de textos y fotos supuestamente oficiales que luego circulan por las redes como pólvora encendida, hay varias maneras de defenderse ante esta avalancha de fake news.

En el caso de los deepfakes, esos videos generados con IA que parecen tan reales, lo primero que podemos sugerir es emplear el sentido común. Lo que usted acaba de ver o leer, ¿le provoca euforia, rabia o miedo? Trátelo como sospechoso hasta que logre demostrar lo contrario.

Verifique antes de compartir cualquier cosa. Busque el origen. Si no puede identificar la fuente primaria, no lo reenvíe. ¿Tiene contexto el contenido, como fecha, hora, lugar? Si eso falta, ponga una bandera roja. Ante comunicados oficiales, revise las fuentes originales que podrían haberlos emitido.

En el caso de los videos y las fotos, «el diablo está en los detalles». La IA todavía tiene problemas con los bordes de los rostros y las manos. Elimina patillas y cambia aretes y gafas. El texto creado por IA, además, no siempre es coherente, aparece deformado en carteles de fondo. Los accesorios a veces son demasiado perfectos. Si es un audio y la dicción es muy perfecta y no hay casi pausas naturales, probablemente sea falso. Una máquina no necesita respirar.

Para las fotos, hay una aplicación que recomiendo mucho: Google Lens. Esta le permite hacer búsquedas a partir de cualquier foto, y rastrear el origen. Además, muestra imágenes similares que pueden enseñarle en segundos un burdo montaje. Y tome en cuenta que puede hacer eso con un video a partir de extraerle un fotograma y subir la foto a Lens.

Y lo más importante. Desmienta la información falsa. Cuando lo haga, edite la foto de la publicación —nunca comparta el bulo— y escriba encima de ella la palabra falso. Cuanto más grande mejor. Así llama la atención de sus contactos.

Fuente: Juventud Rebelde